El escalado funciona, pero menos. En 2020 un equipo de investigadores de OpenAI publicaron un estudio titulado "Leyes del escalado para Modelos Neuronales de Lenguaje". En él planteaban una especie de Ley de Moore de la IA: cuantos más datos y cómputo dedicases a entrenar modelos, mejor serían. Aquella observación se demostró claramente cuando lanzaron GPT-3, que era 10 veces más grande que GPT-2 pero era mucho, muchísimo mejor que aquel modelo.

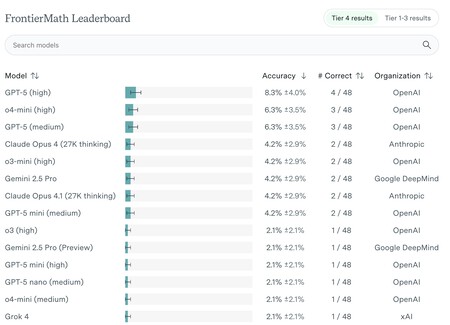

Pero GPT-5 no está tan mal. Lo cierto es que GPT-5 ha mejorado en métricas relevantes. Los responsables de Epoch AI evaluaron su comportamiento en FrontierMath, por ejemplo. Los resultados eran un poco mejores que su predecesor o4-mini, pero no había grandes saltos de rendimento. Aun así destacaban cómo GPT-5 sí ha sido el primer modelo en lograr resolver un problema concreto como si "hubiera comprendido totalmente el problema".

En el ámbito de las matemáticas, GPT-5 se comporta algo mejor que sus predecesores, pero la diferencia no es radical. Los problemas más difíciles (Tier 4) siguen siendo casi imposibles para los modelos de IA. Fuente: Epoch AI.

En el ámbito de las matemáticas, GPT-5 se comporta algo mejor que sus predecesores, pero la diferencia no es radical. Los problemas más difíciles (Tier 4) siguen siendo casi imposibles para los modelos de IA. Fuente: Epoch AI. Y piensa mejor. Otro análisis independiente del analista Zvi Mowshowitz señalaba que aunque el modelo base de GPT-5 era correcto sin más, sus variantes avanzadas (GPT-5 Pro y GPT-5 Thinking) eran una mejora sustancial respecto a o3-Pro y o3 respectivamente, sobre todo al mitigar las alucinaciones. Según sus datos, "GPT-5 Auto" (la versión base) parece un producto pobre a no ser que uses el plan gratuito de ChatGPT".

Así nunca llegaremos a una AGI. Thomas Wolf, cofundador y Chief Science Officer de Hugging Face, reflexionaba sobre el problema hace unos meses y llegaba a la conclusión de que las IAs se han convertido en "un país de hombres que dicen sí a todo en servidores". Para él las cosas empezaban a ser inquietantes:

"Para crear a un Einstein en un centro de datos no necesitamos un sistema que tenga todas las respuestas, sino más bien uno que sea capaz de preguntarse cosas que nadie había pensado o nadie se había atrevido a preguntar".

Como apuntaba este experto, la IA actual no genera (normalmente) nuevo conocimiento, y "simplemente llena los huecos de lo que los humanos ya sabían". La IA actual es como un estudiante fantástico y muy aplicado, pero ese estudiante no desafía lo que se le ha enseñado. No lo cuestiona y no propone ideas que van contra los datos con los que ha sido entrenado. Yann LeCun, uno de los pioneros de la IA, ya llegó a una conclusión sobre la IA generativa actual: es tontísima.

Bajando expectativas. El panorama es preocupante para quienes están invirtiendo miles de millones de dólares en centros de datos o en entrenar nuevos modelos fundacionales, sobre todo porque ese impacto puede no ser tan gigantesco como habían pronosticado y prometido. Ed Zitron indicaba en The New Yorker que "este es un mercado de 50.000 millones de dólares, no uno de un billón de dólares". Marcus se mostraba de acuerdo. "De 50.000 millones, sí. Quizás de 100.000".

Pero muchos probablemente esperábamos más. Mucho más. Y ahí está el problema. En las expectativas.

Imagen | Levart Photographer

En Xataka | Hay demasiados modelos de IA. Eso plantea una verdadera sentencia de muerte para Anthropic y Claude

-

La noticia Los escépticos de la IA avisaron de que nos estábamos emocionando mucho y no les creímos: la IA es tontísima fue publicada originalmente en Xataka por Javier Pastor .

☞ El artículo completo original de Javier Pastor lo puedes ver aquí

No hay comentarios.:

Publicar un comentario