Hace casi dos décadas, Facebook intentó algo ambicioso: transformar su red social en una plataforma. Quiso ser no solo el lugar donde la gente hablaba, sino donde también sucedían las cosas: jugar, comprar, aprender... todo a través de 'aplicaciones' que funcionaban como componentes de la propia red social.

La red de Mark Zuckerberg se permitió soñar (muy infructuosamente) con ser la puerta de entrada al resto de Internet. Hoy, OpenAI quiere hacer exactamente eso con ChatGPT. Y aunque el contexto tecnológico ha cambiado radicalmente, la jugada —como advierten muchos analistas— tiene un aire de déjà vu.

De chatbot a 'sistema operativo conversacional'

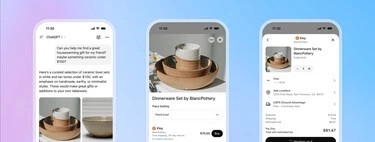

Ayer, durante su 'Dev Day 2025', Sam Altman anunció el lanzamiento de la Apps SDK, un kit de desarrollo que permite crear aplicaciones directamente dentro de ChatGPT. Hasta ahora, ChatGPT había sido un asistente textual, un buscador inteligente y, más recientemente, una herramienta con memoria, voz y visión.

Pero el movimiento más reciente lo convierte en algo distinto: un entorno de ejecución para apps conversacionales. Los ejemplos iniciales son llamativos. Con un simple mensaje, el usuario puede pedir:

- "Canva, crea una presentación para mi negocio",

- "Zillow, muéstrame casas con jardín en Pittsburgh",

- "Spotify, hazme una lista de reproducción para la fiesta del viernes".

El riesgo de repetir la historia de Facebook

Pero esta misma lógica fue la que condenó a Facebook a un escándalo monumental. Y es que su apertura a terceros acabó en un desastre de privacidad: el caso Cambridge Analytica, que reveló el acceso masivo a datos de 87 millones de usuarios. La crisis no solo dañó su reputación: también mató su sueño de ser una plataforma abierta.

OpenAI asegura que ha aprendido la lección. Sus políticas de seguridad y privacidad son estrictas: los desarrolladores deben declarar qué datos solicitan, incluir políticas públicas y pasar revisiones antes de publicar. Sin embargo, la diferencia fundamental es que ChatGPT no gestiona un 'grafo social', sino algo potencialmente más sensible: las conversaciones privadas de los usuarios.

Si se produjera una fuga de permisos o un uso indebido de los datos compartidos entre ChatGPT y una app, las consecuencias serían graves. No hablamos solo de gustos o amistades, sino de información íntima, laboral, médica o emocional. Como advierte Casey Newton en Platformer, "el grafo de la IA puede ser incluso más arriesgado".

¿Espacio para la neutralidad?

Otro riesgo latente es el deformar la experiencia del usuario con incentivos económicos. Igual que Google se transformó bajo el peso del SEO y la publicidad, ChatGPT podría acabar priorizando las apps que paguen por visibilidad o integración.

Hoy, OpenAI insiste en que no mostrará apps "promocionadas" a costa de la utilidad, pero el incentivo está ahí: si el chat empieza a sugerir aplicaciones no porque sean las mejores, sino porque son las que más pagan, la relación de confianza entre usuario y asistente podría erosionarse rápidamente. Lo reconoce el propio Altman:

"Si aceptamos un pago por algo que no deberíamos, en lugar de mostrar lo que creemos mejor, eso destruiría la relación muy rápido".

Un golpe para el ecosistema de startups

La otra cara de esta jugada es su impacto sobre las startups de 'wrappers' —esas empresas que habían construido productos sobre ChatGPT o lo integraban con servicios externos, desde buscadores mejorados hasta asistentes verticales.

Hasta ahora, estos proyectos ofrecían valor al actuar como intermediarios entre el usuario y los modelos de OpenAI. Pero con la Apps SDK, OpenAI les ha pasado por encima. Las empresas que antes vivían de ofrecer "ChatGPT + X" ahora competirán directamente con ChatGPT, que podrá hacer X dentro de su propio entorno.

-

La noticia OpenAI está intentando con ChatGPT la misma jugada que le salió mal a Facebook hace 20 años: convertirse en una plataforma de apps fue publicada originalmente en Genbeta por Marcos Merino .

☞ El artículo completo original de Marcos Merino lo puedes ver aquí

No hay comentarios.:

Publicar un comentario